ClearSightNet可以评估摄像头的可见度并帮助确定遮挡、障碍以及可见度降低的根本原因。

自动驾驶实验室

这是NVIDIA DRIVE Labs自动驾驶实验室系列视频的第三集,在上一集中我们介绍了NVIDIA如何借助基于AI的实时感知进行交叉路口检测。在自动驾驶实验室系列视频中,我们将以工程技术为重点的视角关注实现自动驾驶汽车的各个挑战以及NVIDIA DRIVE AV软件团队如何应对这些问题。

任务:

接入摄像头视野并评估其可见度

方法:

ClearSightNet深度神经网络

自动驾驶汽车依靠摄像头来实现对周围环境的观察。然而,一些环境因素,比如雨、雪和其他障碍,会影响摄像头的可见度。除了能够感知周边环境,任何一个可靠的感知系统都应当有推断出传感器所传输数据有效性的能力。为了实现这一点,在数据被下游模块处理之前,感知系统在处理管道中能够尽早地检测到无效数据是十分必要的。

NVIDIA开发出了一种深度神经网络(DNN)ClearSightNet。它可以评估摄像头的可见度并帮助确定遮挡、障碍以及可见度降低的根本原因。我们在开发ClearSightNet的时候考虑到了以下需求:

-

拥有从造成摄像头失明的各种潜在原因中推理出根本原因的能力

-

输出可操作的有意义信息

-

必须十分轻巧,能够以最小的计算消耗在多个摄像头上运行

ClearSightNet根据摄像头失明的两种情况将摄像头图像分成不同的对应区域,这两种情况分别是遮挡和可见度降低。

遮挡部分所对应的摄像头视野区域是:摄像头被不透明遮挡物(如灰尘、泥土或雪等)遮挡的情况;以及摄像头不包含任何信息,如因太阳照射而造成像素饱和的情况。在这些区域当中,感知通常会完全受损。

可见度降低部分对应的区域是:当摄像头没有被完全阻碍,但由于大雨、水滴、炫光和雾等因素导致可见度受损的情况。在这种情形下,摄像头的感知往往是部分受损,但依然被看作拥有较低的置信度。

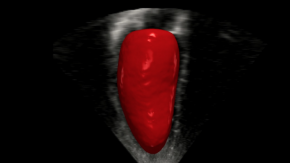

该深度神经网络输出能够在输入图像上覆盖一层图层从而实现可视化:完全遮挡的区域显示为红色,可见度降低或部分遮挡的区域显示为绿色。此外,ClearSightNet还能输出一个比率或百分比,用以说明输入图像受到遮挡或可见度降低影响的区域占比。

ClearSightNet输出示例。输入图像(左)和经ClearSightNet输出图层覆盖的输入图像(右)。 在图中所示的情况下,84%的图像像素受到遮挡的影响,其中部分遮挡显示为绿色,完全遮挡显示为红色。

该信息能以多种方式被使用。例如,当可见度低时,车辆可以选择不开启自动驾驶功能,并提醒用户清洁摄像头镜头或挡风玻璃,或者使用ClearSightNet输出以通知用户摄像头感知可信度计算结果。

无论是当前还是未来版本,ClearSightNet都会持续输出端到端的分析以及关于摄像头失明的详细信息,从而对汽车实现最大程度的控制。

在性能方面,基于INT8校准原理的ClearSightNet目前在Xavier上每帧运行时间约为0.7 ms(离散GPU)和1.3 ms(集成GPU)。ClearSightNet已在NVIDIA DRIVE软件9.0版本中可用。

分享到微信

分享到微信

分享到微博

分享到微博