深入了解 DPU:讲述驱动数据中心网络的引擎

2021-09-01 10:17

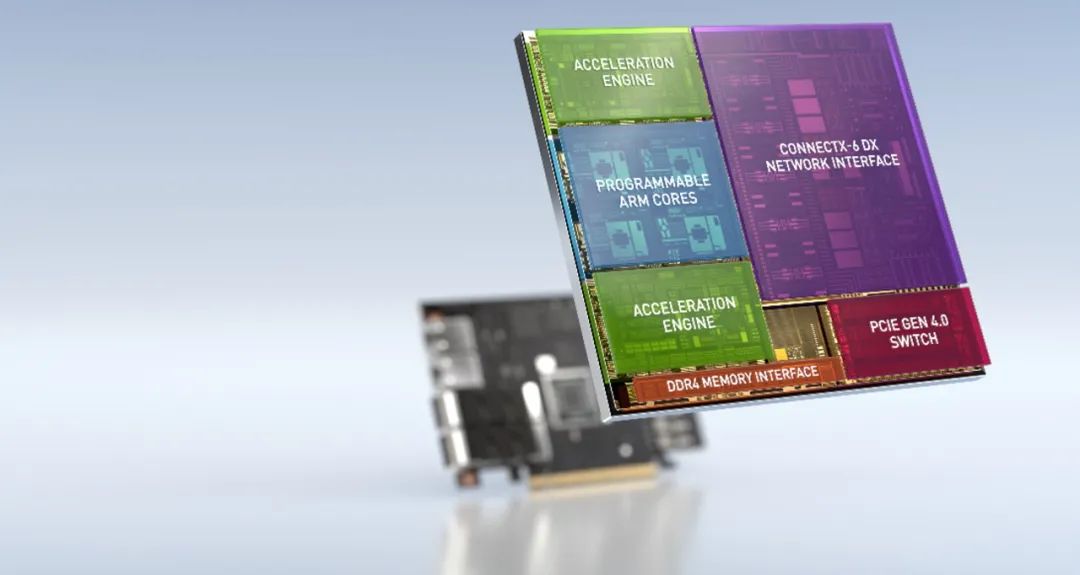

近日,科技界首次详细介绍了 NVIDIA BlueField DPU(数据处理器)的内部结构。该芯片在去年开创了 DPU 这个类别,并且已经得到云服务、超级计算机以及许多原设备制造商和软件合作伙伴的支持。

Idan Burstein 是领导 NVIDIA 以色列 BlueField 设计团队的首席架构师,他在 Hot Chips 上讲解了 DPU 的架构,Hot Chips 大会每年都吸引着许多世界顶级微处理器设计师来参加。

此次演讲揭秘了这个用于加速现代数据中心的芯片—— 一个由硬件加速器和通用 Arm 核组成的阵列,可用于加速网络、安全和存储工作。

这些工作包括在实现数据中心硬件虚拟化的同时,确保网络流量的安全和顺畅。这项工作涉及到加速硬件中日益增加的各种任务,而这些任务对数据中心的运行至关重要。包括:

安全领域的 IPsec、TLS、AES-GCM、RegEx 和 Public Key Acceleration

存储领域的 NVMe-oF、RAID 和 GPUDirect Storage

网络领域的 RDMA、RoCE、SR-IOV、VXLAN、VirtIO 和 GPUDirect RDMA,以及

视频传输和时效性通信领域的卸载

这些应用的增长速度超过了摩尔定律,并且已消耗三分之一的服务器 CPU 周期。DPU 通过打包专用硬件来更高效地运行这些应用,释放更多的 CPU 核以用于数据中心应用。

在达到裸金属性能的情况下,DPU 可以实现虚拟化和高级安全。其用途涵盖云计算、媒体传输、存储、边缘处理,以及高性能计算等多个领域。

NVIDIA 首席执行官黄仁勋将 DPU 描述为“未来计算的三大支柱之一…… CPU 用于通用计算,GPU 用于加速计算,而 DPU 则用于数据中心的数据移动和处理。”

一个完整的即插即用栈

让 Hot Chips 大会上的处理器架构师着迷的好消息是用户只需要将现有的软件插入熟悉的高级软件接口,就可以使用 DPU,他们不会有软件移植的额外工作。

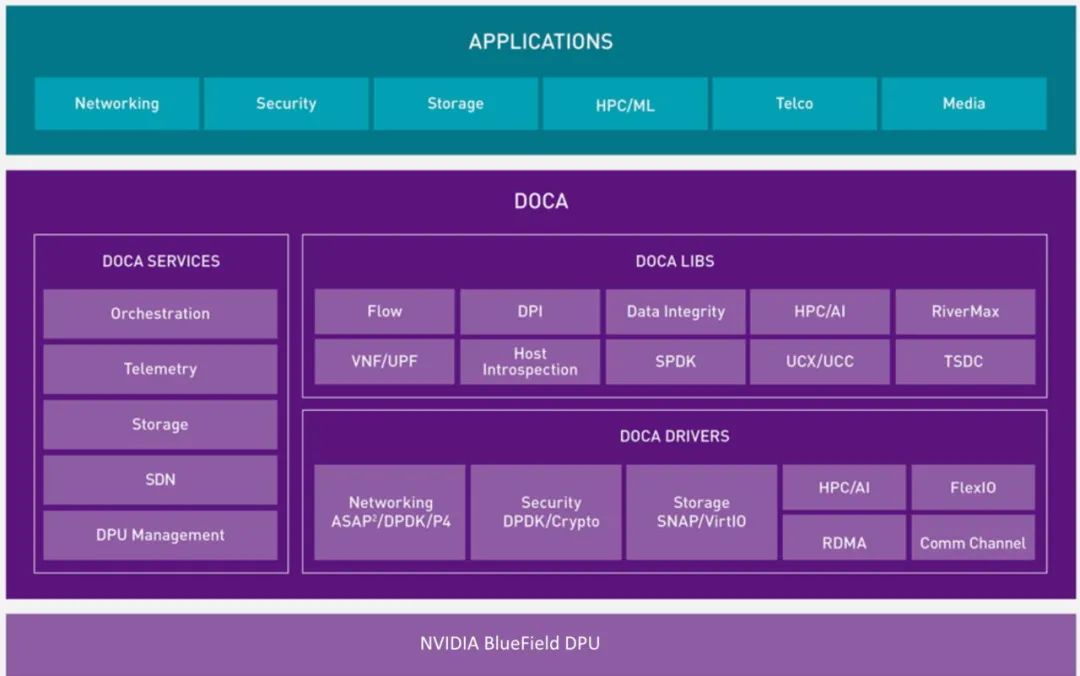

这些接口 API 都集中在一个被称为 NVIDIA DOCA 的 DPU 软件栈中。该栈包括驱动程序、库、工具、文档、示例应用和运行时环境,可在整个数据中心的数千个 DPU 上进行配置、部署和编排的服务。

目前,已收到数百家企业机构提出的提前体验 DOCA 的申请,其中包括了一些全球行业的领导者。

DOCA 提供一个用于在 DPU 上快速开发网络、存储和安全应用的软件平台

DPU 在数据中心和云中的应用

这个在 Hot Chips 上亮相的架构,正在被应用于几个全球最大的云以及一台 TOP500 超级计算机,并与新一代防火墙集成。它很快将在多家顶级 OEM 的系统中可用,这些系统拥有十多个其他合作伙伴提供的软件支持。

目前,为了安全提供计算实例,全球各地多家云服务提供商正在使用,或准备部署 BlueField DPU。

BlueField 赋能超级计算机和防火墙

剑桥大学利用 DPU 的高效率特性,在 6 月首次推出英国最快的学术系统,这台超级计算机在 Green500 全球最节能的系统榜单上排名第三。

作为全球第一台云原生超级计算机,该计算机使研究人员能够在没有任何性能影响的情况下,以保证隐私和安全的方式共享虚拟资源。

凭借来自 Palo Alto Networks 的 VM 系列新一代防火墙,每个数据中心现在都可以使用 DPU 的安全功能。采用 BlueField-2 加速的 VM 系列的新一代防火墙可以检查以前无法追踪的网络流量。

DPU 将被应用于华硕、Atos、戴尔科技、富士通、技嘉科技、新华三、浪潮、广达/QCT,和超微提供的系统,其中有几家企业已经在 5 月的 Computex 上宣布。

十多家软件合作伙伴将支持 NVIDIA BlueField DPU,其中包括:

VMware:通过 Project Monterey 提供支持,该项目将 DPU 带给 30 多万家企业其高速、应用广泛和安全的方案。

Red Hat:通过即将发布的 Red Hat Enterprise Linux 和 Red Hat OpenShift 开发者工具包提供支持。财富 500 强中 95%的企业均使用 Red Hat Enterprise Linux 和 Red Hat OpenShift。

Canonical:在 Ubuntu Linux 中提供支持。该系统是公有云领域最受欢迎的操作系统。

Check Point Software Technologies:在其产品中提供支持。全球有超过 10 万家企业机构使用该公司的产品来预防网络攻击。

其他合作伙伴包括 Cloudflare、DDN、Excelero、F5、Fortinet、Guardicore、Juniper Networks、NetApp、Vast Data 和 WekaIO。

NVIDIA DPU 获得的支持十分广泛,因为其蕴含着巨大机会。

NVIDIA 首席财务官 Collette Kress 在 5 月的财报电话会议中表示:“全球的每一块网络芯片都将成为智能网络芯片……这就是 DPU —— 一块支持数据中心的芯片。” 他预言每台服务器迟早都将有一个 DPU。

DPU 驱动的网络即将到来

Dell’Oro Group 的市场观察家预测,智能网络端口的出货量将从 2020 年的 440 万增加到 2025 年的 740 万,几乎增长一倍。

为了应对这一增长,NVIDIA 在 GTC 大会上宣布了其未来两代 DPU 的路线图。

明年出样片的 BlueField-3 将把最高网络速度提高至 400 Gb/s 并具备 x86 300 个核的网络处理能力。而随着 NVIDIA AI 计算技术的嵌入,BlueField-4 的性能将飞跃提升。

从市场趋势和本周的 Hot Chips 讲座中可以明显看出,如同在 AI 领域的步伐一样,NVIDIA 现在也在引领着加速网络领域的发展。

分享到微信

分享到微信

分享到微博

分享到微博